Holomedizin (Virtual Reality im OP) - Medizin der Zukunft

Interview mit Prof. Dr. Dirk Weyhe - Einblicke in die aktuelle Forschung und Entwicklungen in der Holomedizin

Auf einen Blick

- Viszeralchirurgie: Die Viszeralchirurgie befasst sich mit der Chirurgie der Eingeweide, einschließlich der Schilddrüse, Speiseröhre, Magen-Darm-Trakt und Bauchspeicheldrüse.

- Krankheitsbilder: Typische Krankheitsbilder in der Viszeralchirurgie sind Schilddrüsenvergrößerung, verschiedene Krebsarten und Eingeweidebrüche.

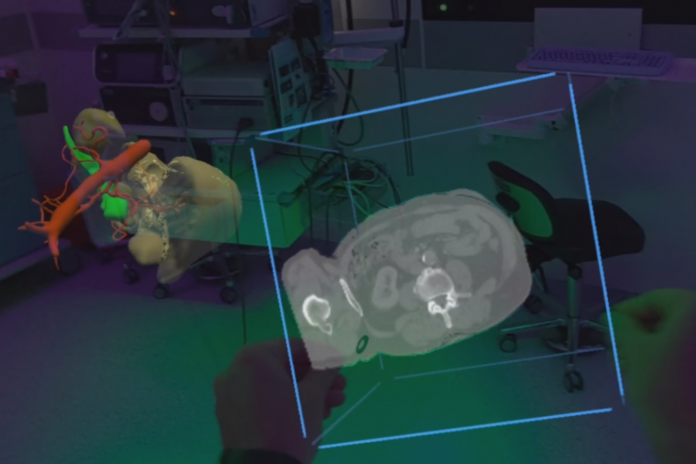

- Holomedizin: Holomedizin beschreibt die 3D-Visualisierung von CT- oder MRT-Daten, die in die Realität projiziert werden, bekannt als Augmented oder Mixed Reality.

- Anwendungsgebiete: Die Holomedizin wird derzeit hauptsächlich für Forschung und Studien verwendet und ist noch kein zugelassenes System.

- Mixed-Reality-Brillen: Mit Mixed-Reality-Brillen, wie der Microsoft HoloLens, können MRT- oder CT-Daten in 3D-Projektionen umgewandelt und dem Operateur während der Operation angezeigt werden.

- Vorteile für Ärzte: Die Holomedizin ermöglicht eine präzisere Operationsplanung und intraoperative Unterstützung, wodurch die Patientensicherheit erhöht wird.

- Vorteile für Patienten: Patienten können von einer genaueren intraoperativen Unterstützung durch Hologramme profitieren, was das Komplikationspotenzial verringert.

- Shared Experience: Die "Shared Experience" ermöglicht es Ärzten, sich als Avatare in einen anderen Operationssaal zu "beamen" und dort beratend tätig zu werden.

- Zukunft der Holomedizin: In den nächsten fünf bis zehn Jahren werden Technologien wie Augmented Reality, Virtual Reality und 3D-Druck in der Medizin immer präsenter sein.

- Deutschlands Position: Deutschland, insbesondere Einrichtungen wie das Holomedicine Center of Excellence in Oldenburg, spielt eine führende Rolle in der Entwicklung und Anwendung der Holomedizin.

Sie sind Direktor der Universitätsklinik für Viszeralchirurgie im Pius-Hospital Oldenburg. Können Sie uns erklären, was die Viszeralchirurgie ist und mit welchen Erkrankungen Patienten zu Ihnen kommen?

Die Viszeralchirurgie ist ein großes Gebiet und umfasst die Chirurgie der Eingeweide. Es beginnt an der Schilddrüse, also im Halsbereich, geht über die Speiseröhre, den Magen-Darm-Trakt, die Bauchspeicheldrüse und alle Bereiche, die die Bauchwand betreffen, wie zum Beispiel die Hernienchirurgie, also die Chirurgie der Brüche. Wir sind ein zertifiziertes Krebszentrum, spezialisiert auf Darmkrebs, Bauchspeicheldrüsenkrebs und Speiseröhrenkrebs sowie Leberkrebs. Das heißt, diese Bereiche sind unsere Schwerpunkte. Ein weiterer großer Schwerpunkt ist die endokrine Chirurgie, das heißt die Chirurgie der Drüsen, wie zum Beispiel der Schilddrüse. Und natürlich das große Gebiet der Hernienchirurgie.

Was sind typische Krankheitsbilder bei Patienten, die zu Ihnen in die Klinik kommen?

Typische Krankheitsbilder sind die Vergrößerung der Schilddrüse, Krebspatienten, in erster Linie aus dem Bereich Darmkrebs, Bauchspeicheldrüsenkrebs mit ihrer Metastasierung in die Leber oder auch in die Lung. Und eben Patienten mit Eingeweidebrüchen.

Sie forschen auf dem Gebiet der Holomedizin. Können Sie erklären, was Holomedizin ist?

Holomedizin ist ein ganz neu aufkommendes Thema und beschreibt die 3D-Visualisierung, also die Übertragung von den CT- oder MRT-Daten, die alle Patientinnen und Patienten haben. Diese werden umgewandelt in 3D-Formate und zum Teil auch farblich abgegrenzt und dann in die Realität projiziert. Das wird auch Augmented Reality oder weiterführend auch Mixed Reality genannt. Das Besondere daran ist, dass wir aus den zweidimensionalen Ebenen, also den planaren und den senkrechten Ebenen im CT und MRT, dieses Bild dreidimensional zusammensetzen. Damit ist es sowohl für die behandelnden Ärzte als auch für die Patientinnen und Patienten auf einen Schlag sichtbar und deutlich erkennbar, wo zum Beispiel die Problematik oder Erkrankung im Organ liegt.

Holomedizin...beschreibt die 3D-Visualisierung, also die Übertragung von den CT- oder MRT-Daten...

Wo wird die Holomedizin eingesetzt?

Die Anwendungsgebiete und der praktische Einsatz sind derzeit ausschließlich im Rahmen von Studien und Forschung erlaubt. Das ist noch kein zugelassenes System. Es ist sehr viel Entwicklungsarbeit erforderlich. Das beginnt damit, dass wir aus den CT- und MRT-Daten, also aus der heutigen Standardbildgebung, diese Daten dreidimensional aufbereiten müssen. Das ist schon ein technischer Schritt, der einerseits Expertise, also Erfahrung, erfordert, aber auch eine entsprechende IT-Infrastruktur. Es ist nicht so einfach, dass man sagt, man nimmt die CD und schiebt sie in ein Laufwerk und anschließend hat man ein 3D-Hologramm. Das ist ein Prozess, der gerade entwickelt wird und wir entwickeln da entscheidend mit. Das ist im Rahmen von Forschungsprojekten einsetzbar und auch schon am Patienten einsetzbar, aber das sind ganz frühe Stadien, in denen wir uns da befinden.

In der Holomedizin werden unter anderem Mixed-Reality-Brillen eingesetzt (wie die Microsoft HoloLens). Damit können MRT oder CT-Daten umgewandelt werden in 3D-Projektionen. Diese werden in das Blickfeld der operierenden Person projiziert.

Was sind die Vorteile einer solchen Projektion für den Arzt?

Diese Mixed-Reality-Brillen, z.B. die Hololens von der Firma Microsoft, nehmen diese Umwandlungen selber gar nicht vor. Sondern das macht eine spezielle Software, also praktisch wie eine App, die hier in Deutschland von der Firma apoQlar entwickelt wird. Und deren Entwicklungen sind sehr weit vorangeschritten. Man muss sich das so vorstellen, wie ein Smartphone. Das Smartphone selber kann ja auch nichts, sondern ist eher eine Technikbereitstellung für die darauf laufenden Apps. So muss man sich das vorstellen. Und diese Umwandlung ist im Moment semiautomatisch. Das heißt, am Ende ist es immer noch ein Radiologe, der diese Umwandlung (Segmentierung) dann auch bestätigt und sagt: Ja, das entspricht tatsächlich jetzt auch dem Bild, wie das im CT oder in den MRT-Daten zu sehen ist. Und dann wird es halt hochgeladen und über die Brille auf den Patienten projiziert.

Eigentlich muss man sich das so vorstellen - Ich bleibe mal bei dem Beispiel VIVA TOP. Das ist ein BMBF-gefördertes Projekt der TZI der Universität Bremen. Und da haben wir uns damit beschäftigt, wie wir Lebertumore oder Metastasen und deren Bezug zur Gefäßanatomie darstellen können. Und entscheidend ist, dass man gerade bei der Leber sehr früh erkennt, welche relevanten Gefäße bei der Operation potenziell geschädigt werden oder umgangen werden müssen. Und das ist sehr, sehr gut gelungen. Wir haben dazu einige Patientenfälle operiert und auch schon präsentiert und das Ganze wurde auch bereits in einem NDR-Beitrag vorgestellt und die Publikationen sind gerade auf den Weg gebracht.

Wie nutzt der Arzt während der OP diese Aufnahmen und Projektionen?

Wir haben drei Schritte. Der erste Schritt ist die Operationsplanung. Wir haben die Hololens auf und sind auch verbunden mit dem OP-Team. Wir können gemeinsam planen. Das heißt auch, dass das gesamte OP-Personal - nicht nur ärztlich, sondern auch pflegerisch - bereits eingebunden werden kann. Und man kann sozusagen die Operation für morgen oder übermorgen planen. Wir haben dann dort die Möglichkeit, uns in einem virtuellen Raum gemeinsam auch als Avatare mit diesem Organ auseinanderzusetzen. Das kann man virtuell größer ziehen, man kann sich bestimmte Operationsschritte schon vorab vereinbaren oder auch einsehen, an welcher Stelle es möglicherweise kritisch wird.

Die Philosophie dahinter ist - bleiben wir beim Beispiel Leber, weil wir dies sehr gut untersucht haben - möglichst viel Lebergewebe zu sparen, weil dann die Erholung, also die Rekonvaleszenz, der Patienten erheblich verbessert ist. Zunehmend geht man weg von großen Leberteilresektionen, wenn es irgendwie zu vermeiden ist.

Was halt also der Arzt von all diesen Innovationen? Er profitiert von dieser Planungssituation. Und am meisten hat der Patient am Ende etwas davon, weil durch diesen Röntgenblick, die Projektion dieses Hologramms über dem OP-Feld oder vielleicht auch in den Situs (Lage der Organe und Strukturen an der OP-Stelle im Körper) hinein, hilft schon bei der Orientierung. Wobei wir uns letztendlich bei der Operation derzeit noch nach den CTs und MRTs richten, die im Raum projiziert sind. Aber man hat schon eine andere Vorstellung. Der zweite Aspekt ist also die intraoperative Unterstützung.

Der dritte Aspekt ist das De-Briefing. Am Ende haben wir die Möglichkeit, diesen Prozess und auch komplexe Fälle den Studierenden und jungen angehenden Ärzten zu erklären. Das heißt, man hebt sie schneller in diese 3D-Vorstellungssituation, als wir das vorher mühsam über diese planaren Schichten hatten. Also sie kennen CTs und MRTs. Entweder sind es Quer- oder Längsschnitte durch den Körper und daraus muss man sich das 3D-Bild zusammensetzen. Und das gelingt eben auch nicht jedem gleich gut. In diesem Fall ist es dann so, dass wir mit dem Hologramm alle zusammen eine Visualisierung haben. Und jeder sieht, wo das Problem tatsächlich liegt, wo wir möglicherweise auch Probleme bei der Operation haben könnten und wie wir diese lösen könnten.

Was sind die Nutzen und Vorteile für Patienten? Was können Patienten sich von der Holomedizin erhoffen?

Wir haben eine Reihe weiterer Projekte, die jetzt noch im Forschungsprozess sind. Der Gewinner ist ganz klar der Patient. Allein in der Vorbereitung auf die Operation, bereiten wir uns als Team vor. Die anatomischen Variationen erfassen wir dort viel schneller als im CT und dem MRT. Das haben wir auch nachgewiesen im Rahmen von Studien, die jetzt gerade publiziert werden. Und die Patienten können sich davon erhoffen, dass sie eine noch präzisere intraoperative Unterstützung durch diese Hologramme erreichen. Das ist ein gewaltiges Potenzial, was in dieser Technologie steckt. Auf der einen Seite führen „deep-learning-Algorithmen“ dazu, dass wir eine Automatisierung haben, eine 3D-Projektion des Körpers und diesen dann exakt auf den Operationssitus legen.

Potenzielle Begleitschäden, die bei der Operation auftreten können, wie zum Beispiel Harnleiterverletzungen bei Krebsoperationen am Mastdarm, hoffentlich vermieden werden können. Weil dann dort sogenannte Annotationen angezeigt werden können, also "Achtung, hier liegt der Harnleiter, hier liegt diese Struktur, dort befindet sich eine gesunde Variation etc." Also die Patienten können sich erhoffen, dass wir das Komplikationspotenzial nochmal deutlich verringern. Das ist die Idee und damit wird die Patientensicherheit auch deutlich erhöht.

Und die Patienten können sich davon erhoffen, dass sie eine noch präzisere intraoperative Unterstützung durch diese Hologramme erreichen.

Spannend ist ja auch die Möglichkeit der “Shared Experience”. Können Sie kurz erklären, was dieser Begriff bedeutet?

Also die Shared Experience hat wahrscheinlich das aktuell größte Potenzial, weil alles andere, was ich vorher genannt habe, sind Dinge, die müssten wir im Rahmen von Zulassungsstudien validieren und als Medizinprodukt dann auch entwickeln. Das „Wir“ heißt immer, wir sind der klinische Partner und dahinter stehen natürlich die Entwicklungsfirma, wie zum Beispiel apoQlar in Hamburg. Aber das Besondere an der Shared Experience ist, dass es eine völlig andere Dimension der Telemedizin ist. Wenn wir heute über Telemedizin nachdenken, dann denken wir an Formate wie dieses, nämlich dass wir softwaregestützt uns sehen und miteinander sprechen. Diese Telemedizin oder diese Ansätze der Shared Experience ermöglichen es, solange man WLAN und Strom hat, sich auf jeden Teil der Welt hineinbeamen zu können als Avatar. In der anderen Welt kann man dann als Avatar mit anderen Hologrammen agieren. Also man kann sich sogar in einen anderen Operationssaal hinzuschalten. Das sind alles Dinge, die funktionieren und die wir schon getestet haben. Der Operateur sieht uns als Avatar, hört uns auch und man kann dann gemeinsam beraten, wie z.B. Zugänge gestaltet werden, wie intraoperativ etwas gelöst werden kann. Man kann natürlich nicht aktiv in die Operation eingreifen, man kann aber sozusagen beratend danebenstehen und dann empfehlen, wie man diese weiteren Schritte lösen kann. Also eine völlig neue Flughöhe der Telemedizin, als wir sie bisher kannten.

Wann könnte die Holomedizin im klinischen Alltag zum Einsatz kommen? Und bei welchen Operationen halten Sie die Holomedizin für sinnvoll, bei welchen eher gar nicht sinnvoll?

Also für einen klinischen Einsatz als Standard sind wir noch zu sehr am Anfang dieser gewaltigen Entwicklung, die sich auch weltweit gerade auch auf den Weg gemacht hat. Ich sehe es schon in erster Linie einsetzbar in der Telekommunikation, also in der Telemedizin. In zweiter Linie direkt einsetzbar im Rahmen der Ausbildung. Das heißt, man kann sich in den Hörsaal hineinbeamen, man kann den Hörsaal in den Operationssaal hinzunehmen und kann mit der Brille mit integrierten Tiefensehkameras den Operationssitus ganz anders darstellen. Das sind Dinge, die heute schon möglich sind, die in der Erprobung sind. Da gehört eine bestimmte IT-Struktur dazu, da gehört Datenschutz dazu, aber das sind Dinge, die heute schon funktionieren.

Im klinischen Einsatz sehe ich es tatsächlich im Moment noch in der Forschung ganz klar bei komplexen Bauchspeicheldrüsen-Operationen, wo wir durch das Organ hindurch schon in Projektion die wichtigen, großen, relevanten Gefäße sehen, die praktisch hinter den Organen verlaufen. Wir sehen, wo es während der OP etwas kritisch werden könnte. Man kann sich den Situs anders darstellen. Das Gleiche gilt bei der Leberoperation. Und wie weit zukünftig auch diese Standardoperationen in der Hernienchirurgie umsetzbar sind, das muss man sehen. Das wird kommen, davon sind wir überzeugt.

Aber die Problematik befindet sich insgesamt in der Viszeralchirurgie. Das heißt, wir haben eine Deformation: Wir haben auf der einen Seite ein CT, bei dem der Patient liegt und das verändert sich ja unter der Operation. Und das muss man eben lösen, wie man einerseits die exakte Übertragung der CT-Daten hinbekommt und auf der anderen Seite die intraoperative Deformation anpasst. Das funktioniert, es gibt Ideen dazu, wie man das lösen kann. Aber das ist einer der Gründe, warum ich wirklich im Moment noch nicht vom Standard sprechen möchte. Das kann man noch nicht absehen.

Wo kommt die Holomedizin an seine Grenzen?

Also aktuell kommt das System eben genau durch die intraoperative Deformation an seine Grenzen. In dem Moment, wo wir den Bauch geöffnet haben, wo wir selbsthaltende Systeme einsetzen, haben wir ja eine andere Situation als vorher. Das CT, das im Liegen aufgenommen wurde, zum Teil bei Atemstillstand, da ist im Moment das System an seine Grenzen gekommen. Bei der intraoperativen Platzierung, wo sich wenig Atemverschieblichkeit ergibt - das ist bei der Bauchspeicheldrüsenoperation zum Beispiel so - Da liegt das Problem nicht so vor, und da laufen auch gerade Studien dazu. Aber die Grenzen sind tatsächlich die Deformationen. Jedoch sind das alles Dinge, die in Zukunft gelöst werden können.

Wo steht Deutschland beim Einsatz der Holomedizin im Vergleich zu anderen Ländern?

Mit Stolz kann ich sagen, dass die ursprüngliche Entwicklung, also dass man zunächst erstmal die Bilddaten aus dem CT und MRT extrahiert und zu einem 3D-Bild macht, das ist tatsächlich eine Entwicklung von Fraunhofer MEVIS, die seit mehr als 20 Jahren hier in Bremen daran arbeiten und diese Thematik auch weltweit führend bearbeiten! Und das ist einer unserer Projektpartner aus dem großen Projekt VIVA TOP. Der nächste Schritt: diese Bilddaten dann in die Augmented Reality zu bringen, das ist die große Leistung der Firma apoQlar gewesen, die das Ganze programmiert für die Hololens mit der VSE Holomedizin. Ich darf sagen, dass wir es in Deutschland nochmal zu einem anderen Reifegrad mitentwickelt haben. Aber es ist tatsächlich so, dass es in Mainz an der Universitätsklinik und in Norddeutschland an Universitätskliniken, wie in Hamburg zum Beispiel, auf den Weg gebracht wurde. Singapur ist ganz klar einer der Vorreiter, die im Gesundheitssystem (NOHS) jetzt anfangen, das groß auszubreiten. Singapur hat natürlich die entsprechenden Strukturen dazu, ähnlich wie auch in Miami, in den USA. Dort befindet sich auch ein Holomedicine Center of Excellence. Hier in Oldenburg hatte uns keiner auf dem Schirm und das macht mich auch sehr stolz, sagen zu können, dass wir zurzeit das dritte zertifizierte Holomedicine Center of Excellence sind, die sich mit diesem Thema intensiv beschäftigen.

Hier in Oldenburg hatte uns keiner auf dem Schirm und das macht mich auch sehr stolz, sagen zu können, dass wir zurzeit das dritte zertifizierte Holomedicine Center of Excellence sind...

Wie wird sich Ihrer Meinung nach die Forschung zur Holomedizin entwickeln? Wo sehen Sie die Holomedizin in 10 Jahren? Wird es uns etwas an Star Trek erinnern?

Die neuen Technologien, wie Augmented Reality, Virtual Reality, 3D-Druck und was es sonst noch an Systemen gibt, werden in Zukunft nicht mehr wegzudenken sein. Und wir brauchen gar nicht so weit in die Zukunft zu schauen. Wir brauchen nur in den nächsten fünf statt zehn Jahren zu schauen, da werden wir sehen, dass diese Technologien in der Telemedizin Einzug gehalten haben, davon bin ich fest überzeugt. Und dass die Kombination all dieser Technologien die Zukunft darstellt.

Und ja, ich bin auch davon überzeugt, dass es ähnlich wie bei Star Trek sein wird, dass wir uns mit Avataren bewegen und weltweit mit dieser Shared Experience, der geteilten Erfahrung, leben werden. Jetzt ist es ja auch schon vorhanden, nur, dass es nicht über den Gaming Markt eingeführt wird, sondern über einen professionellen Bereich. Virtual Reality und Augmented Reality kamen über die Firma Meta auch schon als Mixed Reality auf den Markt. Die Brille Meta Quest Pro zum Beispiel ist noch gar nicht bekannt und steht kurz vor der Markteinführung. Bei dieser Brille würden diese Technologien kombiniert. Man ist dort in einem virtuellen Raum, einem virtuellen Operationssaal, in dem man sich mit mehreren Kollegen trifft, entweder zur Weiterbildung, zur Fortbildung oder zu Besprechungen – das werden die Arbeitsplätze der Zukunft sein. Das ist ein Aspekt, den man nicht vernachlässigen darf. Man wird das Reisen drastisch vermindern können und trotzdem eine Interaktion haben, die viel immersiver, viel intensiver ist, als wir das zum Beispiel über klassische Zoom-Calls haben.

Vielen Dank für das Interview!

Letzte Aktualisierung am 28.09.2023.